Создателем синтезатора речи был Гомер Дадли из Лабораторий Белла. В некрологе коллега описывал Дадли как одного из «величайших “старомодных” изобретателей», которого было трудновато понимать, потому что он слишком быстро говорил: «Язык у него работал как телеграфный аппарат» [12]. К слову, именно медленная работа телеграфного кабеля заставила Дадли искать лучшие способы передачи речи, потому что высокие звуковые частоты находились за пределами возможностей кабеля. Эта работа и привела к созданию синтезатора речи.

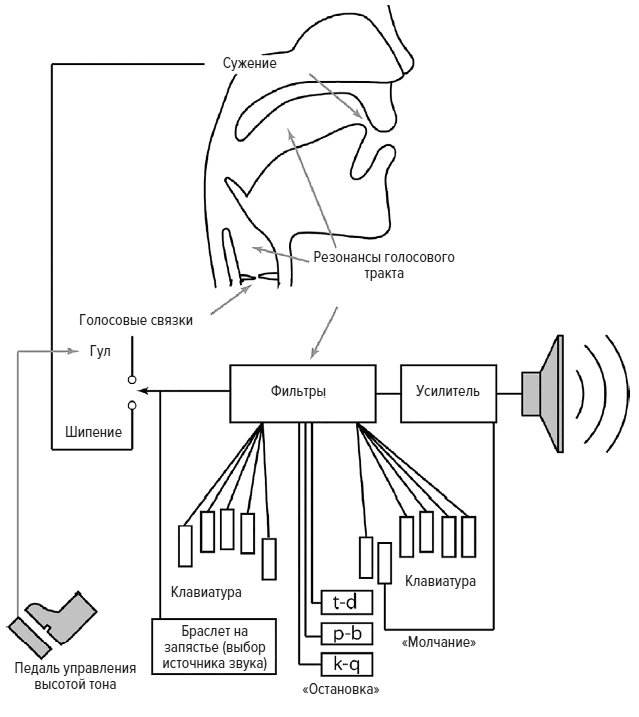

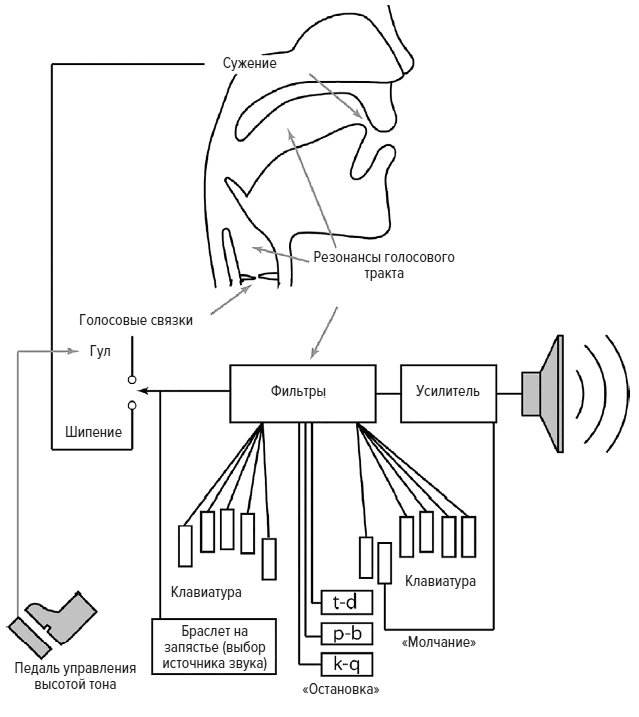

Синтезатор речи Дадли (Voder) [14]

Дадли понял, что гудение голосовых связок, которое создает проблематичные для передачи высокие частоты, можно отделить от более медленных движений рта, языка и горла, поэтому сигнал, описывающий эту медленную артикуляцию, можно легко передавать по кабелю [13]. Хотя кабель не мог передавать звук голосовых связок, приемнику достаточно было передать частоту гудения, а затем можно было ее воссоздать на другом конце, используя генератор сигналов. Эта идея отделения источника звука от эффектов голосового тракта легла в основу создания синтезатора речи.

Фотография девушки-оператора за синтезатором, управляющей этой машиной на Всемирной выставке, напоминает мне о стенографистках, работающих в суде [15]. С помощью браслета на запястье выбирается звонкий (создается гудение, симулирующее звук голосовых связок) или глухой звук, например [ш]. Поскольку устройство электронное, звуки начинаются как сигналы, проходящие через электрическую схему. Ножная педаль изменяет высоту тона гудения, создавая примитивную интонацию. Затем звук проходит через электронные фильтры, которые формируют его, симулируя эффект голосового тракта. Наконец, усилитель и громкоговоритель превращают электронные сигналы в звуковые волны, проходящие через воздушную среду.

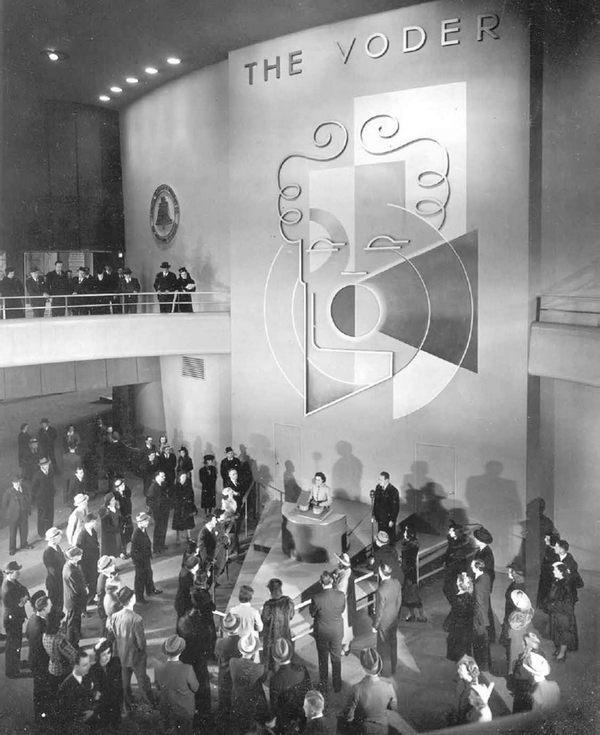

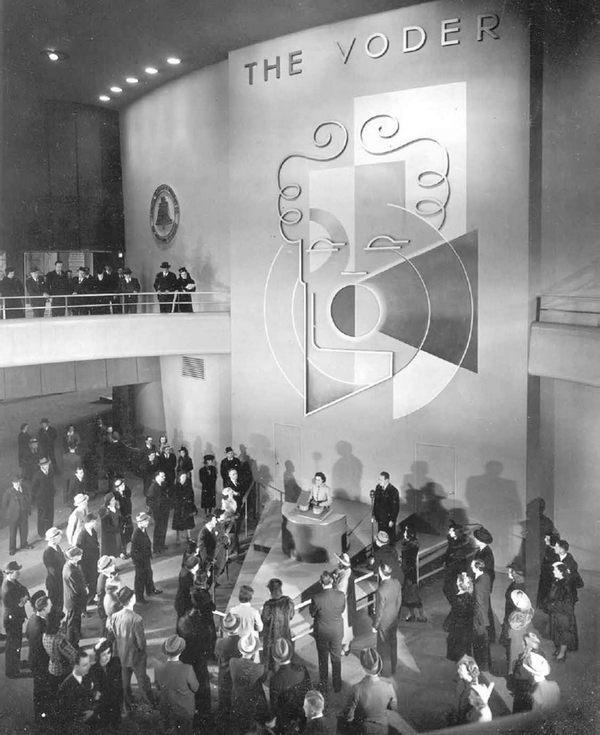

Чтобы научиться пользоваться этим синтезатором речи, требовался год. Оператор, миссис Хелен Харпер, рассказывала, как сложно было воспроизвести слово «концентрация»: «Мне нужно сформировать последовательно 13 разных звуков, сделать пять движений вверх-вниз браслетом на запястье и три-четыре раза изменить положение педали в зависимости от того, насколько выразительным я хотела бы заставить машину сделать это слово. И конечно, все это нужно было точно синхронизировать». Особенно трудно было справиться со звуком [л]. В 1939 году в одной из статей Time отмечалось, что машина не может произнести название лаборатории, в которой она изобретена, – по всей видимости, вместо «телефоны Белла» получалось что-то вроде «тевефоны Бева» [16]. Как раньше делал Кемпелен, ведущий предварительно подготавливал аудиторию, произнося слова, которые затем пыталась произнести машина, чтобы помочь мозгу слушателя сгладить ошибки в произношении.

Синтезатор Дадли на Всемирной выставке 1939 года в Нью-Йорке

Хотя синтезатор производил членораздельную речь, он звучал как говорящий церковный орган. Иногда подстройка рычагов управления создавала немного пьяную, смазанную интонацию. При этом голос синтезатора звучал более естественно, чем знаменитый механический голос Стивена Хокинга, потому что умелые операторы, подобно концертирующим пианистам, очень быстро подстраивали рычаги управления, чтобы улучшить звук.

С распространением цифровой электроники можно было избавиться от «кукловода»-человека, и синтетический голос стал более независимым. Первым бытовым прибором стал Speak N Spell, игрушка компании Texas Instruments, выпущенная в 1978 году [17]. Тогда синтезатор речи, втиснутый в небольшое и довольно примитивное электронное устройство, считался чудом техники. Но я сомневаюсь, что сегодня кто-то стал бы использовать для обучения игру, в которой приходится разбирать непонятные слова, и без того трудные в написании. У Speak N Spell в запасе было 200 слов, что вряд ли помогло бы в чтении Шекспира, но начиная с 1970-х годов мощность компьютеров несоизмеримо увеличилась, а качество звука в цифровых системах стало намного лучше. Но, несмотря на это, поразительно редко можно увидеть актера-робота, говорящего синтезированным голосом. Есть, правда, одна певица-андроид, которая выступает перед тысячами фанатов и даже сопровождала Леди Гагу в одном из ее туров.

Это поющий персонаж Хацунэ Мику, что означает «Первый звук из будущего» [18]. Я посмотрел несколько представлений и очень надеюсь, что в будущем мне не придется слушать только такую «музыку»! Хацунэ Мику часто поет в сопровождении настоящей рок-группы, а ее слишком резкий девчачий голос выпевает романтические баллады практически без эмоций. На сцене ее визуальным воплощением является псевдообъемная проекция девочки-аниме с длинными конскими хвостами и огромными глазами. Когда гитарист выдает пронзительное соло, она танцует, как девочка-подросток, а фанаты подпевают.

Технология, с помощью которой создано пение Хацунэ Мику, напоминает обычные способы синтеза речи. Наверняка вы слышали такой синтезированный голос, делающий объявления об отправлении и прибытии поездов или озвучивающий меню в телефоне. Если все сделано хорошо, то речь похожа на настоящую. Если плохо, то можно услышать, как это делается. Здесь используется конкатенативный (компиляционный) синтез, при котором отрывки записанной заранее речи монтируются так, чтобы получились предложения. По сути, это звуковой эквивалент записки с требованием выкупа, склеенной из вырезанных из газеты кусочков. Чтобы создать такую речь, актер записывает огромное количество текстов, которые затем разрезаются на фрагменты и формируют базу данных, включающую части слов, целые слова, словосочетания и предложения. Новые предложения создаются путем выбора соответствующих отрезков из базы данных и их последовательного склеивания. Это уже новые предложения, которых актер не произносил. Если перед склеиванием использовать простую аудиообработку, например понижение интонации в конце фразы, можно добиться практически естественного звучания. Однако иногда интонация неестественно перескакивает, и это указывает на то, что речь синтезирована. Мы настолько привыкаем к естественному голосу, что даже одна фальшивая нота способна разрушить иллюзию, что говорит человек.

Пение Хацунэ Мику сделано с помощью программного обеспечения «Вокалоид», работающего по похожему принципу [19]. Делается многочасовая запись реального пения, затем она режется на куски, которые заносятся в базу данных для создания новых песен. Записи подбираются и обрабатываются так, чтобы высота голоса соответствовала мелодической линии. Программа также позволяет композитору контролировать вибрато, тембр и динамические характеристики для придания музыке выразительности. Секрет успеха Хацунэ Мику в том, что фанаты покупают программу «Вокалоид» и пишут для нее песни, которые потом загружают в интернет. Хацунэ Мику – звезда, созданная фанатами, и они могут ею управлять: создавшая этот голос компания утверждает, что в базе данных больше 100 000 песен. Хацунэ Мику не нужно звучать естественно, так как в японской популярной музыке даже голоса реальных певцов часто подвергаются обработке и похожи на механические.