Эту... задачу можно описать в терминах игры, известной нам как «имитирующая игра». В нее играют три человека: мужчина (А), женщина (5) и спрашивающий (С), который может быть любого пола. Цель игры для спрашивающего — определить, кто из двух других — мужчина, а кто — женщина. Для него они помечены как X и У, и в конце игры он должен сказать либо: «Х — это А, а Y — это В», либо: «X — это В, а Y — это A». Спрашивающий может задавать А и В следующие вопросы: С: Не скажет ли мне X, какая у него длина волос?

Теперь предположим, что X — это на самом деле А; тогда А должен ответить. Целью игры для А является... заставить С сделать ошибочную идентификацию. Его ответ мог бы быть таким:

«Мои волосы коротко острижены, самые длинные пряди длиной примерно 9 дюймов». Чтобы тембр голоса не указывал спрашивающему на пол, ответы пишутся или еще лучше печатаются. Самый лучший вариант — это принтер, подключенный в соседней комнате. Другим вариантом может быть повторение ответов посредником. Цель третьего игрока (В) — помочь спрашивающему. Возможно, наилучшая стратегия — это давать правдивые ответы. Игрок может прибавлять к своим ответам что-то вроде: «Это я — женщина, не слушай его!» — но это ничего не даст, поскольку так может сказать и мужчина.

Теперь спросим: «Что произойдет, если роль А в этой игре будет исполнять машина?» Будет ли спрашивающий при таком варианте игры ошибаться так же часто, как и тогда, когда играют мужчина и женщина? Эти вопросы заменяют первоначальный: «Может ли машина мыслить?»

Очевидно, эффективность некоторых вопросов, задаваемых X и Y, зависит от моды: если за основу различения взять длину волос и прическу, то, например, в 1970-х годах это привело бы к значительным ошибкам. Тем не менее для специалистов по языку и ИИ в задаче Тюринга есть очень важный момент — для того, чтобы компьютер перехитрил нас и заставил думать, что он — человек, он должен понимать и генерировать ответную реакцию, которая успешно имитировала бы важную когнитивную функцию.

«Китайская комната»

Чтобы продемонстрировать, что жесткая позиция относительно ИИ не выдерживает критики, Сирл предложил следующую головоломку. Предположим, что некоего человека заперли в комнате, где находится много китайских текстов. Этот человек ничего не понимает по-китайски и даже не способен отличить китайские иероглифы от каких-либо других. Ему в комнату передают еще один набор китайских знаков вместе с набором правил для сопоставления первого и второго набора символов. Эти правила всего лишь позволяют связывать один набор символов с другим, и написаны они на английском языке. При помощи этих правил сопоставления человек в «китайской комнате» может давать осмысленные ответы на вопросы о содержании китайских текстов, несмотря на то что он, в сущности, не знает этого языка. Через какое-то время он приобретает такую сноровку, что может отвечать как на своем родном английском, так и на китайском языке, которого не знает, но дает ответы, основываясь на правилах. Результаты настолько хороши, что их «совершенно нельзя отличить от ответов урожденного китайца» (Searl, 1980). Человек, запертый в «китайской комнате», — это простая конкретная иллюстрация компьютерной программы: «данные на входе-данные на выходе». Вплоть до этого момента почти никто из ИИ-защитников не возражает, но затем Сирл делает еще один шаг вперед. Способность выполнять такие функции, как перевод по сложным правилам, не означает, что тот, кто это делает, понимает значение «выходных данных». Человеческий разум характеризуется произвольностью (см. Searl, 1983), которая, согласно Сирлу, определяется как «свойство психических состояний и явлений, направляющее их на объекты и ситуации в окружающем мире». К таковым относятся убеждения, страхи, желания и намерения. Независимо от того, насколько «неотличимо» поддельное мышление от «настоящего» (человеческого), они не суть одно и то же, поскольку у мыслящего человека есть намерения и поскольку между этими двумя «мыслящими» существуют физические различия: одного сделали органическим способом, а второго — электронным.

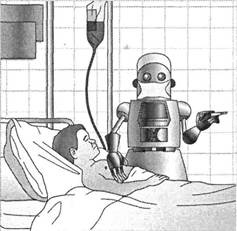

Критические размышления: хирург Робби

Вопрос неразличимости функций в другой сфере деятельности рассматривается иначе. Например, предположим, что в больнице работают два хирурга. Один хирург — дипломированный специалист известной медицинской школы, считающийся одним из лучших хирургов в мире. Другой окончил малоприметную медицинскую школу и оценивается как плохой хирург. Однажды потребовалась срочная операция, а первый врач заболел, поэтому второй врач делает операцию без ведома пациента, который находится без сознания. Пациенту не сказали, какой врач его оперировал, и он доволен тем, что операция прошла успешно. Кроме того, другие врачи убеждены, что операция была сделана первым хирургом. Из этого примера мы можем заключить, что тест на неразличимость пройден успешно. Однако, если бы вы были пациентом и узнали, что операцию в действительности делал робот, какой бы вывод вы сделали о профессиональных качествах робота в сравнении с профессиональными качествами хирурга? Вы бы согласились, что они одинаковы? Почему да или почему нет? Трудно дать ответы на эти вопросы, но только не для людей, имеющих твердые убеждения по этому вопросу, таких как Сирл, «вывернувший наизнанку» тест Тюринга.

Опровержение «китайской комнаты»

Компьютерщики немедленно выдвинули возражения против головоломки Сирла (см. Boden, 1989) — прежде всего с позиций семантики: термины «произвольность», «понимание», «мышление» употребляются им без четких операциональных референтов. В качестве возражения был приведен такой пример: если бы человек в «китайской комнате» выполнял описанные функции, то он (или система) действительно достиг бы как минимум некоторого уровня понимания. Кроме того, аргументы Сирла отклонялись на основании «приведения к абсурду»: если довести ситуацию до логического конца, то оказалось бы возможным создать робота, в каждой своей детали идентичного мыслящему человеку, и все же последний был бы способен к «пониманию» и «произвольности», а первый — нет. Наконец, некоторые специалисты по ИИ полагают, что «понимание» и «произвольность» вызываются конкретными материальными свойствами. Пилишин (Pylyshyn, 1980) с иронией замечает, что, возможно, произвольность — это такое вещество, которое выделяется человеческим мозгом; он предлагает свою собственную загадку:

...Если бы все больше и больше клеток вашего мозга заменялись интегральными микросхемами, запрограммированными так, чтобы их характеристики входа-выхода были идентичны заменяемому элементу, вы, по всей вероятности, сохранили бы способность говорить точно так же, как и сейчас, за исключением того, что постепенно перестали бы что-либо под этим иметь в виду. То, что мы, сторонние наблюдатели, все еще принимали бы за слова, для вас стало бы просто некоторым шумом, который заставляют вас издавать ваши микросхемы.